智創(chuàng)未來,技展風(fēng)采——我校成功承辦2023年云南省職業(yè)院校技能大賽“智能電子產(chǎn)品設(shè)計(jì)與開發(fā)”賽項(xiàng)

由云南省教育廳主辦、我校承辦的2023年云南省職業(yè)院校技能大賽“智能電子產(chǎn)品設(shè)計(jì)與開發(fā)”賽項(xiàng)圓滿落幕。本次大賽旨在深入貫徹落實(shí)國家關(guān)于職業(yè)教育改革發(fā)展的決策部署,推動產(chǎn)教融合、校企合作,檢驗(yàn)和展示我省職業(yè)院校在智能電子技術(shù)領(lǐng)域的教學(xué)成果與人才培養(yǎng)質(zhì)量,為區(qū)域電子信息產(chǎn)業(yè)發(fā)展選拔和儲備高素質(zhì)技術(shù)技能人才。

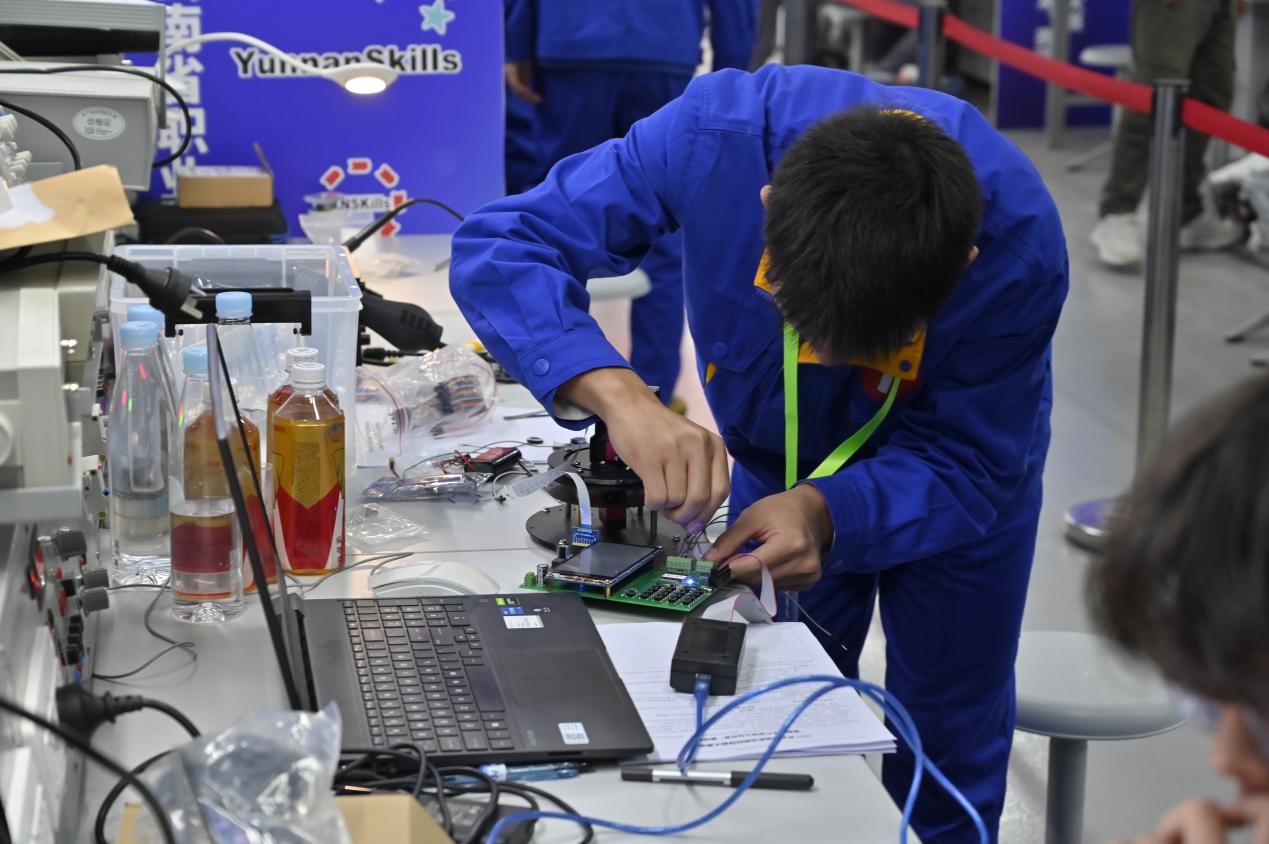

賽事吸引了來自全省各地職業(yè)院校的數(shù)十支代表隊(duì)同臺競技。比賽內(nèi)容緊扣行業(yè)發(fā)展前沿,聚焦智能電子產(chǎn)品的核心設(shè)計(jì)與開發(fā)流程,全面考核參賽選手在電路設(shè)計(jì)、嵌入式系統(tǒng)開發(fā)、傳感器應(yīng)用、軟件編程、產(chǎn)品調(diào)試及技術(shù)文檔撰寫等方面的綜合能力。選手們需要在規(guī)定時間內(nèi),獨(dú)立或協(xié)作完成從需求分析、方案設(shè)計(jì)到硬件制作、軟件編寫,直至最終產(chǎn)品功能實(shí)現(xiàn)與優(yōu)化的全流程任務(wù)。賽場內(nèi),參賽者們神情專注,操作嫻熟,充分展現(xiàn)了扎實(shí)的專業(yè)功底、敏銳的創(chuàng)新思維和良好的團(tuán)隊(duì)協(xié)作精神。

作為承辦單位,我校高度重視此次大賽的組織與服務(wù)工作。學(xué)校成立了專項(xiàng)工作小組,精心籌備,在賽項(xiàng)規(guī)程制定、賽場環(huán)境布置、設(shè)備器材保障、技術(shù)支持和后勤服務(wù)等方面做了周密安排,確保了大賽的公平、公正與順利進(jìn)行。現(xiàn)代化的實(shí)訓(xùn)場地、先進(jìn)的儀器設(shè)備以及嚴(yán)謹(jǐn)細(xì)致的賽務(wù)管理,贏得了主辦方、裁判及參賽師生的一致好評。

此次大賽的成功舉辦,不僅為全省職業(yè)院校電子信息技術(shù)相關(guān)專業(yè)的師生提供了一個高水平的切磋交流平臺,更是一次對我校相關(guān)專業(yè)建設(shè)水平和辦學(xué)實(shí)力的集中檢閱與展示。通過以賽促教、以賽促學(xué)、以賽促改,有效促進(jìn)了專業(yè)教學(xué)內(nèi)容與行業(yè)技術(shù)標(biāo)準(zhǔn)的對接,激發(fā)了學(xué)生的學(xué)習(xí)熱情與創(chuàng)新潛能,對深化教育教學(xué)改革、提升技術(shù)技能人才培養(yǎng)質(zhì)量起到了積極的推動作用。

我校將繼續(xù)秉持“匠心鑄魂,技能報(bào)國”的育人理念,緊密對接產(chǎn)業(yè)發(fā)展需求,不斷優(yōu)化專業(yè)結(jié)構(gòu),深化產(chǎn)教融合,努力為社會培養(yǎng)更多具備精湛技藝和創(chuàng)新能力的高素質(zhì)電子信息技術(shù)人才,為服務(wù)地方經(jīng)濟(jì)社會發(fā)展和制造強(qiáng)國戰(zhàn)略貢獻(xiàn)更大的力量。

如若轉(zhuǎn)載,請注明出處:http://www.025bgypw.cn/product/53.html

更新時間:2026-04-14 14:52:59